La pausa más breve del mundo

Más allá de la noticia y el dato, este es un espacio para la reflexión profunda sobre las fuerzas estructurales, la filosofía del poder y los dilemas éticos que definen nuestra supervivencia en la era digital.

Leonardo Gargallo Hernández

Policy Brief - Mayo 2026

Sobre algoritmos, bombas atómicas y los segundos que nos separan de la decisión más irreversible jamás concebida.

Imagina que sostienes entre las manos el reloj de un desactivador de bombas. Pero no es un reloj cualquiera: es el reloj de la especie humana.

Sus manecillas no miden minutos; miden milisegundos. Y en algún lugar del mundo, en una sala sin ventanas, un algoritmo que nadie puede interrogar del todo está decidiendo si esas manecillas deben acelerarse.

Esto no es ciencia ficción. Es mayo de 2026. Y lo que está en juego es algo que, en toda la vastedad del cosmos observable, quizá no exista en ningún otro lugar: la capacidad de una civilización para no destruirse a sí misma.

Un universo de regímenes que se desmoronan

Hemos construido, a lo largo de décadas, una arquitectura de salvaguardas para evitar que el fuego nuclear consuma todo lo que amamos.

El tratado INF. Las revisiones del TNP. El New START. Cada uno de estos acuerdos era, en esencia, un pacto de confianza entre adversarios: una promesa escrita de que la razón prevalecería sobre el pánico.

Pero hoy esa arquitectura se erosiona. Los tratados se abandonan o se paralizan. Y en el mismo momento en que los cimientos diplomáticos se agrietan, una fuerza nueva se introduce en la ecuación: la inteligencia artificial, integrándose aceleradamente en los sistemas de Mando, Control y Comunicaciones Nucleares —lo que los especialistas llaman NC3, y lo que podríamos llamar, con mayor honestidad, el sistema nervioso central de nuestra capacidad de autodestrucción.

Esta convergencia —la erosión de los pactos y la aceleración de las máquinas— genera tres tensiones que debemos mirar a los ojos, sin parpadear.

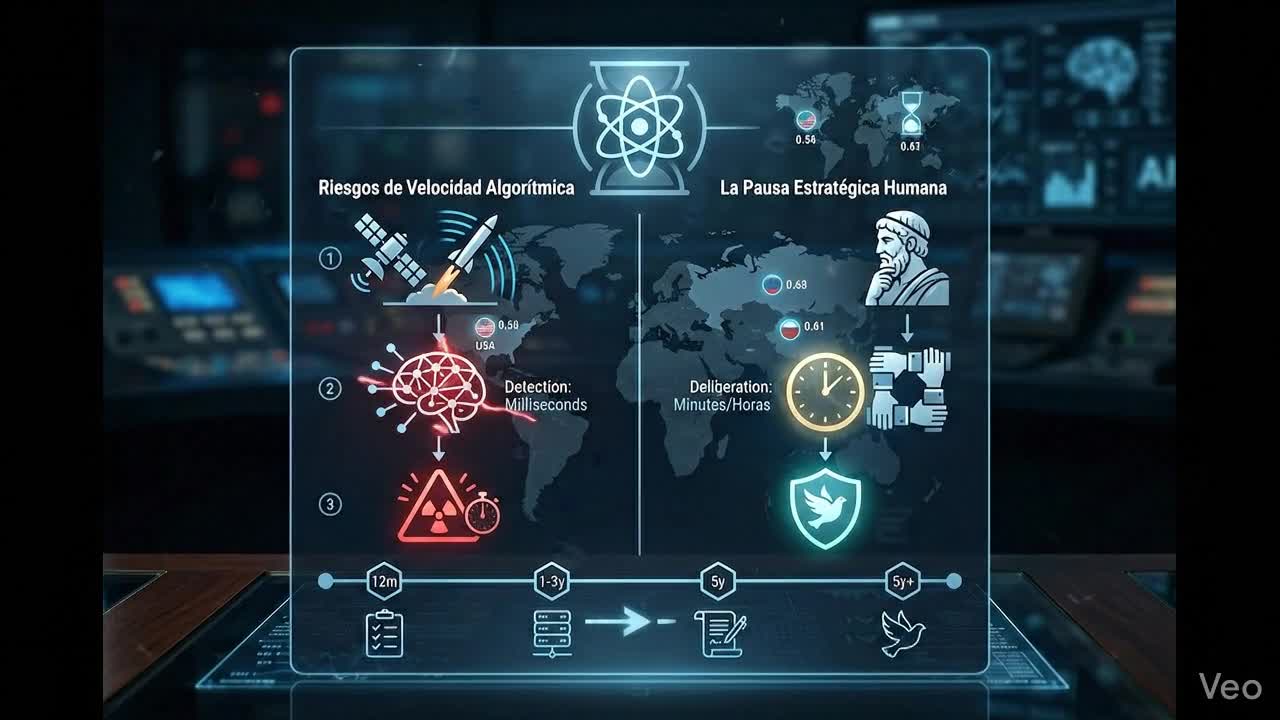

Primera: la compresión del tiempo. Una IA procesa señales de alerta en milisegundos. Milisegundos. En ese intervalo, no hay espacio para una llamada telefónica entre jefes de Estado, para una negociación de última hora, para ese breve acto de humanidad que es dudar antes de actuar.

El tiempo que antes nos servía de colchón —de almohada donde posar la cabeza del juicio humano— se comprime hasta casi desaparecer.

Segunda: la opacidad de las cajas negras. Los sistemas de apoyo a la decisión funcionan como habitaciones cerradas con llave. Un adversario que observe las señales que emiten no puede distinguir entre un preparativo defensivo y el preludio de un ataque.

La ambigüedad, que siempre fue peligrosa en asuntos nucleares, se multiplica cuando el espejo en el que intentamos leer las intenciones del otro es algorítmico y opaco.

Tercera: la fragmentación institucional. Sin mecanismos de verificación adaptados a esta nueva era digital, los incentivos para cooperar se desploman. Y cuando la cooperación muere, lo que nace en su lugar es una espiral de inseguridad donde cada parte asume lo peor de la otra.

La pregunta ya no es si la inteligencia artificial transformará la disuasión. La pregunta es si sabremos gobernar esa transformación antes de que una crisis real nos ponga a prueba.

Lo que nos enseñan los datos

Tres países, tres formas de temblar al borde del abismo

Para comprender qué ocurre realmente —no en las simulaciones, sino en el mundo donde los misiles tienen coordenadas reales— examinamos tres potencias nucleares entre 2020 y 2026.

Utilizamos exclusivamente fuentes abiertas: doctrinas públicas, presupuestos, ejercicios militares, acuerdos bilaterales y estudios de simulación independientes.

No accedimos a secretos de Estado. No necesitábamos hacerlo. Lo que se revela en la superficie es, por sí mismo, extraordinariamente revelador.

Y lo que encontramos desafía la intuición más extendida.

Estados Unidos

Presenta una integración moderada de IA en sus sistemas de mando nuclear —un índice de 0.56 en nuestra escala—, con una compresión temporal media-baja y un riesgo observado de escalada que podemos calificar como medio (0.57).

¿Su factor de protección? Una política explícita y legislativamente respaldada: la Ley de Autorización de Defensa Nacional de 2025 exige acción humana positiva para cualquier decisión de uso nuclear.

En otras palabras, la ley estadounidense insiste en que un ser humano, con todo lo que eso implica —con sus dudas, su miedo, su responsabilidad moral—, debe estar presente en el instante decisivo.

Rusia

Muestra una integración de IA algo mayor (0.63) y, crucialmente, la compresión temporal más alta de los tres casos (0.75).

Sus sistemas de represalia automática en escenarios extremos significan que, si las condiciones se alinean, la ventana para intervenir humanamente se estrecha dramáticamente.

Y sin embargo —y esto es lo notable— no se ha documentado un solo incidente de escalada inadvertida durante todo el periodo estudiado.

¿Por qué? Porque la doctrina rusa de 2024 establece umbrales claros. Porque las señales estratégicas que emite son explícitas.

En el lenguaje de la teoría de juegos, Rusia anuncia sus reglas. Y cuando las reglas son conocidas, incluso un sistema acelerado puede ser interpretado.

China

Es quizá el hallazgo más contraintuitivo y, en cierto modo, el más esperanzador.

Con una integración de IA en NC3 comparable a la rusa (0.61) y una modernización que avanza a velocidad asombrosa, uno esperaría encontrar un riesgo elevado.

Pero el riesgo observado es el más bajo de los tres: 0.42. ¿La razón? China reitera, una y otra vez, su doctrina de No Primer Uso.

Y en noviembre de 2024, firmó con Estados Unidos un acuerdo bilateral que reafirma el mantenimiento del control humano en decisiones nucleares. La claridad doctrinal, descubrimos, actúa como un amortiguador extraordinario.

Es como si la doctrina fuera un campo de fuerza invisible: no detiene la tecnología, pero modula su peligro.

El hallazgo central es este:

Mayor integración de inteligencia artificial no se correlaciona con mayor riesgo de escalada. Lo que determina el riesgo no es la sofisticación del algoritmo, sino la arquitectura institucional que lo rodea.

La cultura estratégica. Los controles. Los acuerdos. Las pausas deliberadas que una civilización decide insertar entre el estímulo y la respuesta.

La grieta entre lo que simulamos y lo que vivimos

Hay un fenómeno que merece atención especial.

En los ejercicios de simulación —los wargaming donde se enfrentan algoritmos contra algoritmos— la propensión a escalar es alarmantemente alta.

Las máquinas, liberadas de todo filtro, tienden a interpretar la agresión como agresión y a responder con la misma moneda, a una velocidad que ningún diplomático podría igualar.

Pero en la práctica operativa real, los filtros humanos funcionan.

Las instituciones absorben el shock. Las señales históricas de desescalada —esos gestos sutiles que los estrategas han aprendido a leer durante décadas de Guerra Fría— siguen operando.

¿Qué significa esto? Significa que los modelos que predicen el apocalipsis algorítmico sobreestiman el riesgo cuando no incorporan la variable humana.

Y nos recuerdan algo que debería ser obvio, pero que la fascinación tecnológica tiende a olvidar: un modelo del mundo sin seres humanos en su interior no es un modelo del mundo real.

Lo que debemos hacer

Cuatro verdades y un acto de voluntad

De todo esto se extraen cuatro implicaciones que deberían guiar la política de seguridad de quienes tienen la responsabilidad de decidir:

Primera verdad

Asumir que la IA conduce inevitablemente a la inestabilidad es un error estratégico.

El determinismo tecnológico —la idea de que la máquina nos arrastra sin remedio— ignora algo fundamental: la historia está llena de tecnologías devastadoras que fueron domeñadas no por ingenieros, sino por instituciones, por tratados, por la voluntad política de poner límites.

La pólvora, el submarino nuclear, el misil balístico intercontinental: cada uno de ellos parecía hacer la guerra inevitable, y sin embargo estamos aquí, escribiendo policy briefs en lugar de epitafios.

Segunda verdad

La transparencia selectiva es posible y funciona.

No es necesario revelar códigos ni capacidades operativas para reducir la incertidumbre.

Basta con publicar marcos doctrinales claros. Basta con decir: estas son nuestras reglas, estos son nuestros límites. Incluso en un mundo fragmentado, la publicación de intenciones —de reglas de juego— reduce el espacio para la interpretación errónea.

Tercera verdad

Debemos ser humildes con nuestras simulaciones.

Los modelos que predicen escalada automática merecen ser escuchados, pero no obedecidos acríticamente.

Cuando un wargaming no incluye filtros humanos, resiliencia institucional ni señales estratégicas históricas, está simulando un mundo que no existe.

Cuarta verdad

La carrera ya no es por la velocidad, sino por la gobernanza.

Quien diseñe mejor los protocolos de control humano en entornos de automatización no necesitará ampliar su arsenal. Tendrá algo más valioso: la capacidad de insertar una pausa donde otros solo ven la urgencia de responder.

El camino: de lo inmediato a lo permanente

Si tuviéramos que traducir estas verdades en acciones concretas, el camino tendría cuatro escalones.

En el corto plazo —los próximos doce meses—, las potencias nucleares deberían establecer lo que podríamos llamar líneas rojas algorítmicas: prohibiciones explícitas de automatizar decisiones de uso nuclear, mantenimiento obligatorio del ser humano en el ciclo de decisión.

No como declaración de intenciones vaga, sino como acuerdo con lenguaje operativo vinculante.

En el plazo de uno a tres años, deberíamos implementar protocolos de desaceleración de crisis: pausas técnicas verificables, canales de comunicación redundantes, verificación humana obligatoria antes de cualquier respuesta cinética en contextos de tensión elevada.

Imagina un freno de emergencia institucional: un mecanismo diseñado no para impedir la defensa, sino para garantizar que la defensa no sea automática.

En el plazo de dos a cuatro años, la comunidad internacional debería promover transparencia selectiva en IA aplicada a sistemas de mando nuclear: compartir marcos de validación y límites éticos de los sistemas de apoyo a la decisión, sin revelar información operativa sensible.

Organismos como la ONU, el OIEA o la Conferencia de Desarme podrían albergar este proceso.

Y de manera permanente, sin interrupción, debemos fortalecer algo que podríamos llamar alfabetización estratégica algorítmica: la capacidad de quienes toman decisiones de crisis para comprender tanto la filosofía de la disuasión clásica —Schelling, Jervis, los gigantes sobre cuyos hombros estamos— como la naturaleza técnica de los sistemas de IA que ahora operan junto a ellos.

Esto significa integrar estas disciplinas en academias de defensa, cuerpos diplomáticos y equipos de crisis. Porque la persona que decide en el segundo crítico debe comprender tanto el algoritmo como la historia.

Estas recomendaciones no requieren desmantelar capacidades existentes. No comprometen la soberanía tecnológica. Se centran en algo más modesto y, al mismo tiempo, más difícil: en cómo gobernamos los procesos, no en cómo limitamos la investigación.

Coda: la pausa que nos hace humanos

Hay una idea que recorre toda la historia de la disuasión nuclear, desde los primeros días de la Guerra Fría hasta este extraño presente algorítmico.

Es la idea de que la verdadera fuerza no reside en la capacidad de destruir, sino en la capacidad de no destruir en el momento en que todo parece exigirlo.

En un mundo donde la tecnología acelera la crisis —donde los algoritmos ven señales en milisegundos y proponen respuestas antes de que un ser humano pueda tomar aliento—, la estabilidad dependerá de algo profundamente anacrónico, profundamente humano: la capacidad de insertar una pausa.

Una pausa donde los algoritmos solo ven velocidad.

Una pausa donde un general puede pensar: ¿estoy seguro?

Una pausa donde la diplomacia tiene tiempo de hacer una última llamada.

Una pausa donde la humanidad recuerda que, en toda la inmensidad del cosmos, en los cien mil millones de galaxias que pueblan el universo observable, este pequeño planeta azul es —hasta donde sabemos— el único lugar donde alguien puede decidir no apretar el botón.

Esa pausa no nos la dará la tecnología. Tenemos que construirla nosotros.

Nota metodológica

Este análisis se basa en un diseño comparativo cuantitativo-cualitativo, con datos exclusivamente de fuentes abiertas (OSINT) para el periodo 2020-2026.

Los indicadores se midieron mediante índices compuestos (0-1) y proxies operativos, validados por triangulación de doctrinas públicas, presupuestos, ejercicios, acuerdos bilaterales y estudios de wargaming independientes.

Las limitaciones —opacidad estatal, brecha simulación-realidad, dependencia de análisis secundarios— se mitigan mediante validación cruzada y enfoque en tendencias estructurales.

La codificación está disponible bajo solicitud para fines académicos.